Когда-то компьютеры были такими большими, что заполняли комнаты. Теперь они везде и невидимы, встроены в часы, двигатели автомобилей, камеры, телевизоры и игрушки. Они управляют электрическими сетями, анализируют научные данные и предсказывают погоду. Без них современный мир был бы невозможен.

Ученые стремятся сделать компьютеры меньше и быстрее, а программы — более интеллектуальными, применяя современные технологии и достижения науки. Их усилия основаны на более чем столетнем опыте инноваций.

Краткая история

В 1833 году английский математик Чарльз Бэббидж задумал программируемую машину, предвосхитившую сегодняшнюю вычислительную архитектуру, с хранилищем для хранения чисел. Машина Бэббиджа имела логические функции, такие как ветвление (если X, то Y). Бэббидж сконструировал часть машины, но, основываясь на ее описании, его знакомая Ада Лавлейс увидела, что числа, которыми она может манипулировать, могут представлять что угодно, даже музыку. «Новый, обширный и мощный язык разработан для будущего использования анализа», — писала она.

Лавлейс стала экспертом в работе предложенной машины, ее называют первым в истории программистом. Спустя сто лет, в 1936 году английский математик Алан Тьюринг представил идею компьютера, который мог бы переписывать свои собственные инструкции, делая его бесконечно программируемым. Его математическая абстракция могла, используя небольшой словарь операций, имитировать машину любой сложности, за что получила название «универсальная машина Тьюринга».

Первый надежный электронный цифровой компьютер Colossus был построен в 1943 году, чтобы помочь Англии расшифровывать коды военного времени. В нем использовались вакуумные трубки — устройства для управления потоком электронов — вместо движущихся механических частей, таких как зубчатые колеса аналитической машины. Это сделало Colossus быстрым, но инженерам приходилось вручную переделывать его каждый раз, когда они хотели выполнить новую задачу.

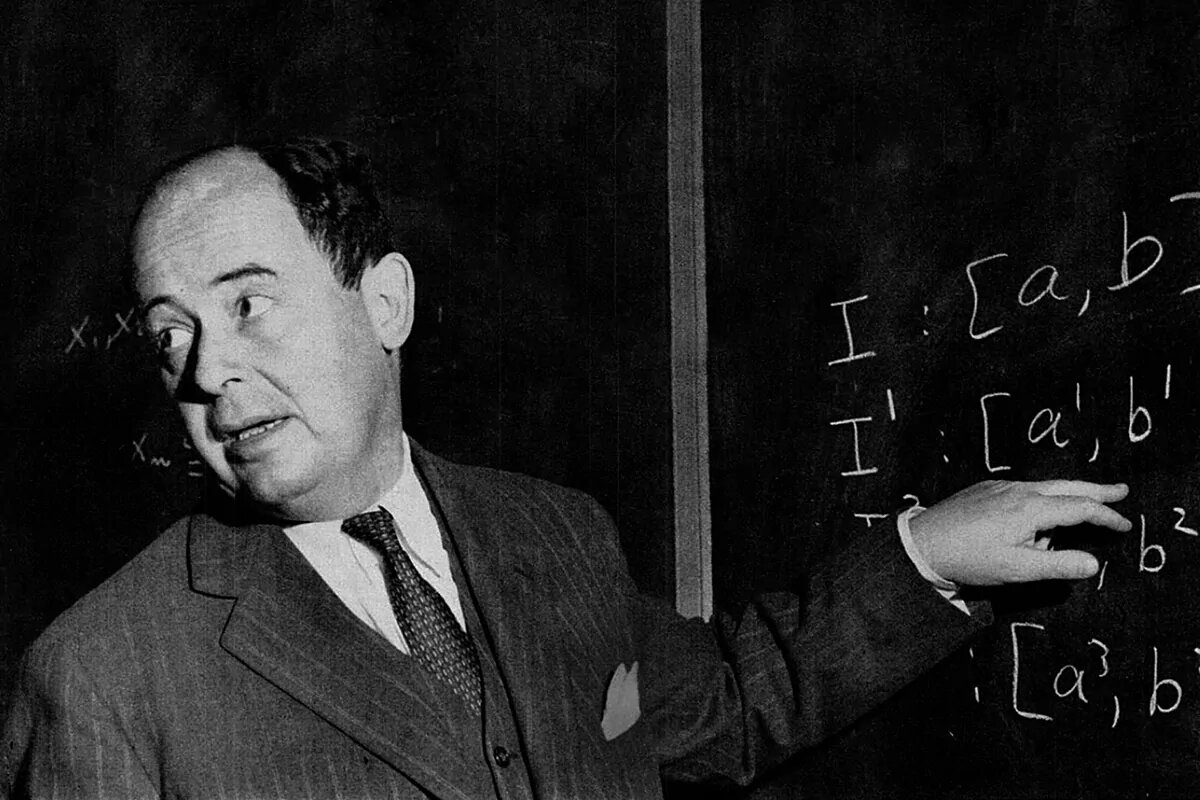

Возможно, вдохновленная концепцией Тьюринга о более легко перепрограммируемом компьютере, команда, создавшая первый в США электронный цифровой компьютер ENIAC, разработала новую архитектуру для одной из первых вычислительных машин EDVAC. Математик Джон фон Нейман, консультировавший разработчиков EDVAC в 1945 году, описал систему, которая могла хранить программы в своей памяти вместе с данными и изменять программы — установка, которая теперь называется архитектурой фон Неймана. Почти каждый современный компьютер следует этой парадигме.

В 1947 году исследователи из Bell Telephone Laboratories изобрели транзистор, который пришел на смену более медленным и менее эффективным электронным лампам. В 1958 и 1959 годах исследователи из Texas Instruments и Fairchild Semiconductor независимо друг от друга изобрели интегральные схемы, в которых транзисторы и поддерживающие их схемы изготавливались на кристалле в рамках одного процесса.

Долгое время только специалисты могли программировать компьютеры. Затем, в 1957 году, IBM выпустила FORTRAN, язык программирования, который гораздо легче понять. Он все еще используется сегодня. В 1981 году IBM представила PC, а Microsoft выпустила свою операционную систему под названием MS-DOS, вместе расширив возможности компьютеров в домах и офисах. Apple дополнительно персонализировала вычисления с помощью операционных систем для своих Lisa в 1982 году и Macintosh в 1984 году. Обе системы популяризировали графические пользовательские интерфейсы или GUI, предлагая пользователям курсор мыши вместо командной строки.

Другие исследователи работали над изменением того, как люди общаются друг с другом. В 1948 году американский математик Клод Шеннон опубликовал статью «Математическая теория связи», в которой популяризировал слово «бит» (для обозначения двоичной цифры) и заложил основы теории информации. Его идеи сформировали вычисления и, в частности, обмен данными по проводам и по воздуху.

В 1969 году Управление перспективных исследовательских проектов США создало компьютерную сеть под названием ARPANET, которая позже объединилась с другими сетями, так был создан интернет. А в 1990 году исследователи из CERN, европейской лаборатории недалеко от Женевы, разработали правила передачи данных, которые легли в основу Всемирной паутины. Эти технологические достижения позволили людям работать и общаться новыми способами, которые существуют сегодня.

Но насколько лучше могут стать компьютеры, насколько умными могут стать алгоритмы? Какие преимущества и опасности ожидают нас по мере развития технологий? Стюарт Рассел, ученый-компьютерщик из Калифорнийского университета в Беркли, соавтор популярного учебника по искусственному интеллекту, видит огромный потенциал компьютеров в «творчестве, развитии науки, работе в качестве личных помощников, вождении автомобилей и — надеюсь — они не убьют нас».

Погоня за скоростью

Компьютеры, по большей части, говорят на языке битов. Они хранят информацию — будь то музыка, приложение или пароль — в строках из 1 и 0. Они также обрабатывают информацию в двоичном виде, переключая транзисторы между состояниями «включено» и «выключено». Чем больше транзисторов в компьютере, тем быстрее он может обрабатывать биты, что делает возможным все, от более реалистичных видеоигр до более безопасного управления воздушным движением.

Объединение транзисторов образует один из строительных блоков схемы, называемой логическим элементом. Логический элемент И, например, включен, если оба входа включены, а элемент ИЛИ включен, если включен хотя бы один вход. Вместе логические вентили составляют сложную схему движения электронов, физическое проявление вычислений. Компьютерный чип может содержать миллионы вентилей.

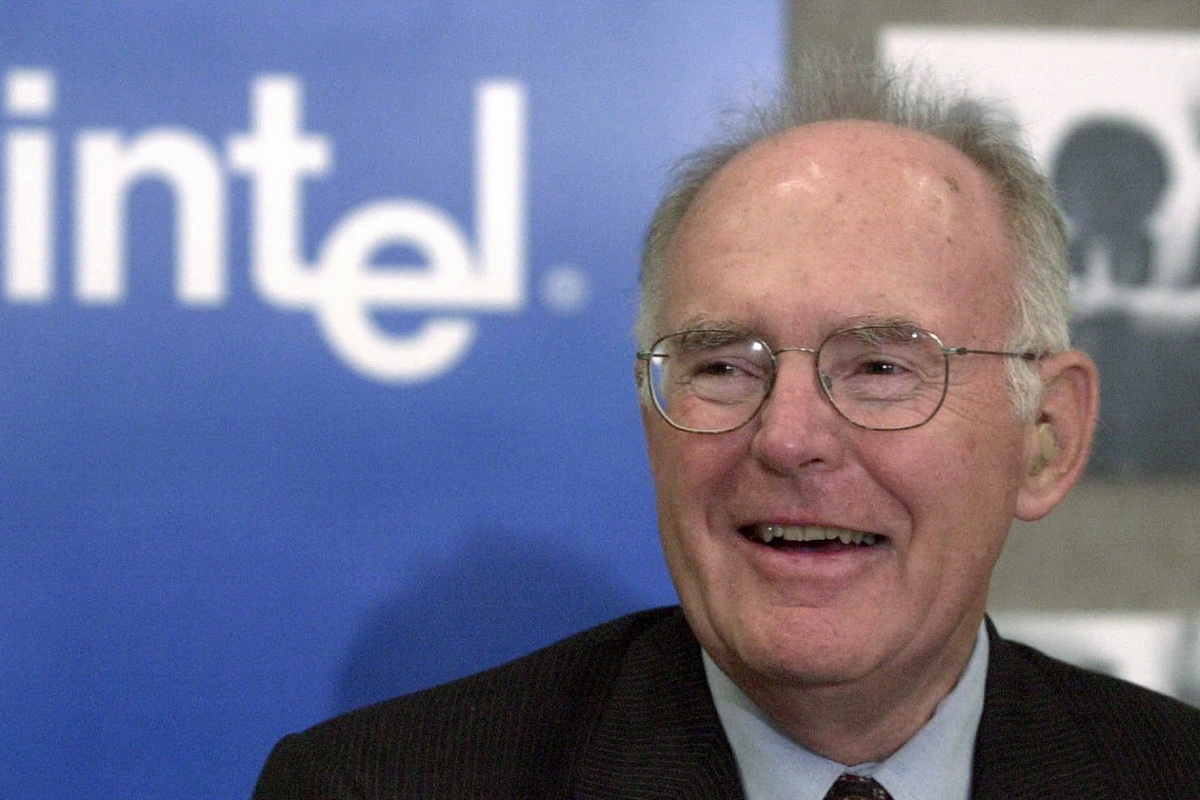

Таким образом, чем больше логических элементов и, следовательно, чем больше транзисторов, тем мощнее компьютер. В 1965 году Гордон Мур, соучредитель Fairchild Semiconductor, а затем и Intel, написал статью о будущем чипов под названием «Втискивая ещё больше компонентов в интегральные схемы». Он отметил, что с 1959 по 1965 год количество компонентов (в основном транзисторов) в интегральных схемах (чипы), удваивалось каждый год. Он ожидал, что эта тенденция сохранится.

В докладе 1975 года Мур определил три фактора, стоящих за этим экспоненциальным ростом: меньшие по размеру транзисторы, большие микросхемы и «умные устройства и схемы». Он ожидал, что удвоение будет происходить каждые два года. Так и было, и это продолжалось десятилетиями. Эта тенденция теперь называется законом Мура.

Закон Мура задумывался как экономическое наблюдение. Всегда будут стимулы делать компьютеры быстрее и дешевле, но в какой-то момент вмешивается физика. Разработка микросхем не может вечно соответствовать закону Мура, поскольку становится все труднее делать транзисторы меньше. Согласно тому, что в шутку называют вторым законом Мура, стоимость заводов по производству микросхем удваивается каждые несколько лет. Сообщается, что полупроводниковая компания TSMC рассматривает возможность строительства завода стоимостью $25 млрд.

Конец закона Мура

Сегодня закон Мура не действует; удвоение происходит медленнее. Исследователи ищут несколько путей решения: лучшие транзисторы, более специализированные чипы, новые концепции чипов и программные решения. «Мы выжали все, что можно выжать из современной архитектуры транзисторов, называемой FinFET», — говорит Санджай Натараджан, руководитель разработки транзисторов в Intel.

Даже если Натараджан прав и транзисторы приближаются к своему минимальному пределу размера, компьютеры все еще имеют много возможностей для улучшения. Примерно до 2004 года сокращение числа транзисторов сопровождалось повышением производительности компьютеров и тактовой частоты — количества циклов операций, выполняемых в секунду. Но этот «закон масштабирование Деннарда» перестал работать, транзисторы с уменьшенным размером перестали приносить преимущества.

Некоторые типы ускорителей могут когда-нибудь использовать квантовые вычисления. Но квантовые компьютеры должны поддерживаться температуры около -273 °С, чтобы горячие, колеблющиеся атомы не мешали тонким суперпозициям и запутыванию кубитов. У квантовых компьютеров есть несколько потенциальных применений: машинное обучение, моделирование реальной квантовой механики и многое другое. Но вряд ли они станут компьютерами общего назначения в ближайшее время.

Развитие ИИ

С первых дней информатики, инженеры и ученые стремились воспроизвести человеческое мышление. Термин «искусственный интеллект» был придуман еще в 1955 году. Спустя более шести десятилетий, искусственный интеллект используется везде от фильтрации спама в электронной почте до самоуправляемых автомобилей. Но это все узкие формы ИИ, хорошо выполняющие одну-две задачи. Ученые хотят большего — ученые хотят разработать общий искусственный интеллект или ОИИ — эта интеллектуальная система, которая делает большую часть того, что делают люди.

Возможно, мы никогда не достигнем ОИИ, но этот путь привел и приведет к множеству полезных инноваций. «Я думаю, что мы добились значительного прогресса», — говорит Дойна Прекап, специалист по информатике из Университета Макгилла в Монреале и глава исследовательской группы DeepMind в Монреале, занимающейся разработкой искусственного интеллекта. «Но одна из вещей, которых мне все еще не хватает сейчас, — это скорее понимание принципов, лежащих в основе интеллекта».

ИИ добился больших успехов за последнее десятилетие, во многом благодаря машинному обучению. Раньше компьютеры в большей степени полагались на символический ИИ, который использует алгоритмы, основанные на установленных человеком правилах. С другой стороны, программы машинного обучения обрабатывают данные, чтобы самостоятельно находить закономерности.

Системы глубокого обучения теперь могут играть в такие игры, как шахматы и го, лучше, чем люди. Они, вероятно, могут определить породы собак по фотографиям лучше. Они могут переводить текст с одного языка на другой. Они могут управлять роботами, сочинять музыку и предсказывать, как будут складываться белки.

Но им также не хватает многого из того, что подпадает под общий термин здравый смысл. Они не понимают фундаментальных вещей о том, как устроен мир, физически или социально. Этого говорит о том, что алгоритмы ИИ нужно улучшать. Как можно улучшить ИИ? Инженеры и ученые-компьютерщики используют несколько форм машинного обучения, независимо от того, является ли оно «глубоким» или нет.

Одна из распространенных форм называется обучением с учителем, при котором системы машинного обучения или модели обучаются, получая маркированные данные, такие как изображения собак и названия их пород. Но для этого требуется много человеческих усилий, чтобы маркировать их. Другой подход — обучение без учителя, с самоконтролем, при котором компьютеры учатся, не полагаясь на внешние ярлыки.

Чтобы эффективно учиться, машинам (и людям) необходимо обобщать, извлекать абстрактные принципы из опыта. «Огромная часть интеллекта, — говорит Мелани Митчелл, ученый-компьютерщик из Института Санта-Фе в Нью-Мексико, — это способность использовать свои знания и применять их в различных ситуациях».

В 2019 году исследователь ИИ Франсуа Шолле из Google создал своего рода IQ-тест для машин под названием «Корпус абстракций и рассуждений» или ARC, в котором компьютеры должны выполнять визуальные паттерны в соответствии с принципами, продемонстрированными в примерах паттернов. Но тесты просты для людей, но пока что сложны для машин. Чтобы реализовать ОИИ, который может делать большую часть того, что могут делать люди, может потребоваться работа с физическим роботом.

Исследователи объединили изучение языка и робототехнику, создав виртуальные миры, в которых виртуальные роботы одновременно учатся следовать инструкциям и ориентироваться в пространстве. GPT-3 — это языковая модель, выпущенная в 2020 году исследовательской лабораторией Open AI, которая показала впечатляющие результаты. С подсказками, модель может писать новостные статьи, короткие рассказы и стихи, но она всё еще удивительно не развита. В одном из демо было написано: «Чтобы с Гавайев допрыгнуть до семнадцати, нужно две радуги».

«Я много играл с GPT-3», — говорит Митчелл. «Он делает невероятные вещи. Но он также может совершать невероятно глупые ошибки». ОИИ могут также потребоваться другие аспекты нашей природы, такие как эмоции, особенно если люди рассчитывают взаимодействовать с машинами естественным образом. Эмоции — это не просто иррациональные реакции. Мы развили их, чтобы управлять нашими стимулами и поведением. По словам Ильи Суцкевера, соучредителя и главного научного сотрудника OpenAI, они «придают нам дополнительную мудрость». Даже если у ИИ нет таких чувств, как у нас, у него может быть код, приближающийся к страху или гневу.

Думая о мышлении

Сам ИИ может помочь открыть новые формы ИИ. Существует набор методов под названием AutoML, в которых алгоритмы помогают оптимизировать архитектуру нейронных сетей или другие аспекты моделей ИИ. ИИ также помогает разработчикам микросхем разрабатывать более совершенные интегральные схемы. Но до прихода ОИИ могут пройти десятилетия. «Мы не понимаем наш собственный интеллект, — говорит Митчелл, — поскольку большая его часть находится в бессознательном состоянии. И поэтому мы не знаем, что будет сложно или легко для ИИ».

То, что кажется трудным, может быть легким, и наоборот — явление, известное как парадокс Моравека, в честь робототехника Ханса Моравека. В 1988 году Моравек писал: «Сравнительно легко заставить компьютеры демонстрировать производительность на уровне взрослых при решении задач на тесты на интеллект или игру в шашки, и трудно или невозможно дать им навыки годовалого ребенка, когда дело доходит до восприятия и мобильности». Дети втайне гениальны. Прекап говорит, что стремясь к ОИИ, «мы также лучше понимаем свой интеллект и интеллект в целом».

Борьба с этикой

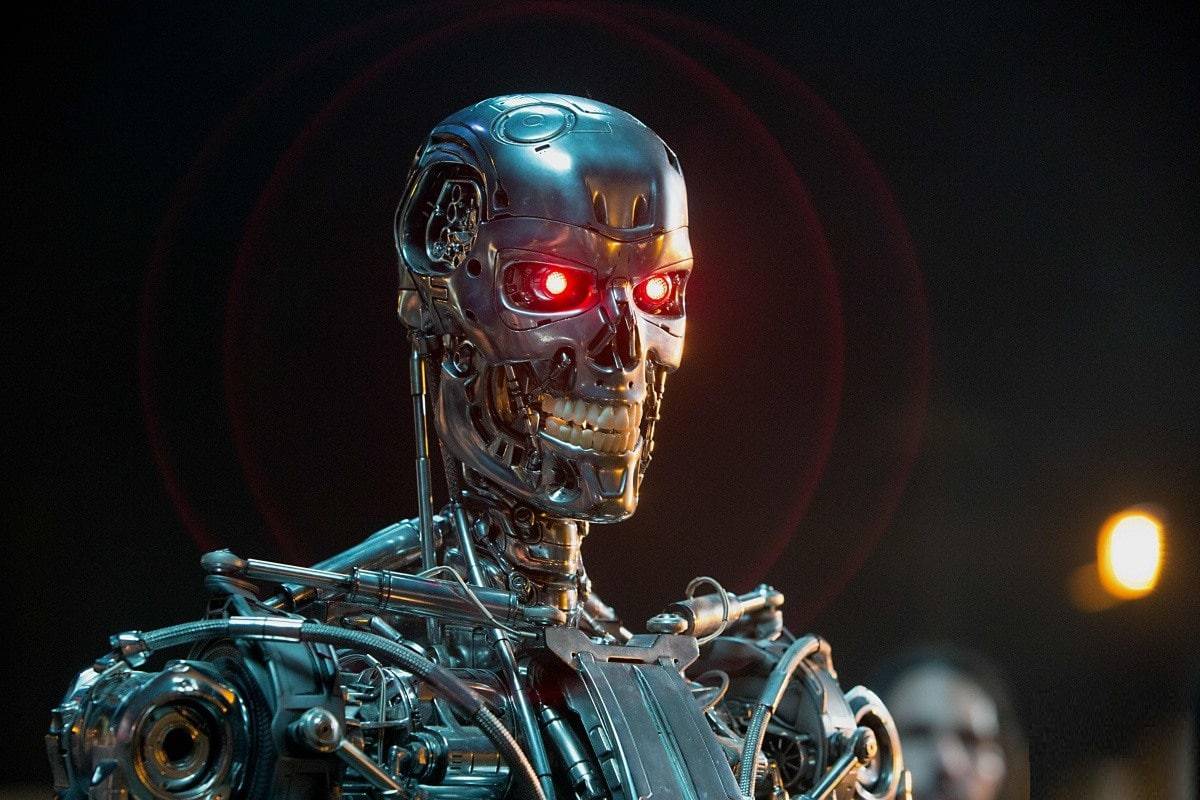

В рассказе 1942 года «Хоровод» один из персонажей Айзека Азимова перечислил «три фундаментальных правила робототехники». Роботы не должны причинять или позволять причинять вред людям, они подчинялись всем приказам людей и защищали себя до тех пор, пока следование одному правилу не противоречило предыдущим.

Мы можем представить себе «позитронный мозг» Азимова, принимающий автономные решения о причинении вреда людям, но на самом деле компьютерам далеко до развития индивидуальности. Вместо человекоподобных роботов, убивающих людей, у нас есть алгоритмы, контролирующие окружающую жизнь. По мере того, как компьютеры все больше проникают в нашу жизнь, нам нужно будет больше думать о том, какие системы создавать и как их внедрять, а также о метапроблемах, таких как, как решать и кто должен решать — как управлять и кто будет управлять алгоритмами?

Это область этики, которая может показаться далекой от предполагаемой объективности математики, науки и техники. Но решение о том, какие инструменты создавать и какие технологии развивать, всегда зависело от наших идеалов и сомнений. Изучение такой заумной темы, как, например, строение атомов, имеет явное отношение как к энергетике, так и к оружию. «Фундаментальный факт состоит в том, что когда вы проектируете компьютерные системы, вы привносите в этот проект некоторый набор ценностей», — говорит специалист по информатике Барбара Гросс.

Еще одной проблемой является конфиденциальность и слежка, учитывая, что компьютеры теперь могут собирать и сортировать информацию об их использовании способом, который ранее был невообразимым. Данные о нашем поведении в интернете могут помочь предсказать аспекты нашей личной жизни, такие как интимная сторона.

Распознавание лиц также может следовать за нами по всему миру, помогая полиции или авторитарным правительствам. А зарождающаяся область нейротехнологий уже тестирует способы прямого подключения мозга к компьютерам. Конфиденциальность связана с безопасностью — хакеры могут получить доступ к заблокированным данным или вмешаться в работу кардиостимуляторов и автономных транспортных средств.

Компьютеризация также способствует обману. ИИ может генерировать контент, который выглядит реальным. Языковые модели могут использоваться для заполнения интернета фейковыми новостями и вербовочными материалами для экстремистских групп. Генеративные сети, тип глубокого обучения, который может генерировать реалистичный контент, может помогать художникам или создавать дипфейки, изображения или видео, показывающие, как люди делают то, чего никогда не делали.

В социальных сетях нам также нужно беспокоиться о поляризации социальных, политических и других взглядов людей. Как правило, алгоритмы рекомендаций оптимизируют взаимодействие (и платформы получают прибыль от рекламы), а не гражданский дискурс. Алгоритмы также могут манипулировать нами другими способами. Робо-консультанты — чат- боты для предоставления финансовых советов или поддержки клиентов — могут научиться понимать, что нам действительно нужно, или изучить наши привычки и психологию, чтобы управлять нами через рекламу.

Есть также социальные, политические и юридические вопросы о том, как управлять технологиями в обществе. Кто должен нести ответственность, когда система ИИ причиняет вред? Как мы можем обеспечить более равный доступ к инструментам ИИ и их преимуществам и убедиться, что они не дискриминируют группы или отдельных лиц? Как дальнейшая автоматизация рабочих мест повлияет на занятость? Можем ли мы управлять воздействием на окружающую среду центров обработки данных, потребляющих много электроэнергии? Должны ли мы предпочтительно использовать объяснимые алгоритмы — а не черные ящики многих нейронных сетей — для большего доверия и отладки, даже если это делает алгоритмы менее предсказуемыми?